Erklärbare KI für neuronale Netze in der Medikamentenentwicklung

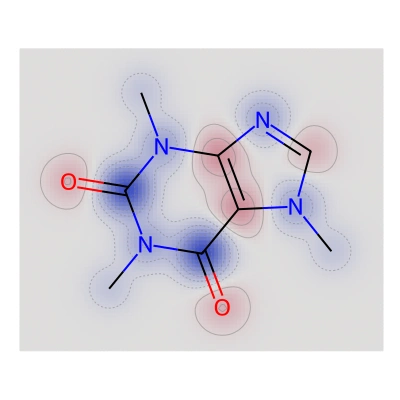

Atomare Beiträge in einem Koffeinmolekül

Atomare Beiträge in einem KoffeinmolekülIn den letzten Jahrzehnten haben sich Künstliche Intelligenz (KI) und Maschinelles Lernen (ML) als leistungsfähige Werkzeuge zur Beschleunigung der Arzneimittelentwicklung erwiesen, insbesondere durch Methoden wie die Modellierung quantitativer Struktur-Wirkungs-Beziehungen (QSAR), die die biologische Aktivität kleiner Moleküle vorhersagen. Allerdings sind die Ergebnisse von ML-Modellen, insbesondere von Neuronalen Netzen, für Wissenschaftler oft schwer zu interpretieren und werden häufig als “Black Boxes” bezeichnet .

Zur Unterstützung eines rationalen Wirkstoffdesigns und zur Erfüllung der zunehmenden behördlichen Anforderungen an die Modelltransparenz werden jetzt erklärbare KI-Methoden (XAI) eingesetzt, um Einblicke in die Art und Weise zu geben, wie ML-Modelle ihre Vorhersagen treffen. Im Jahr 2024 wurde Koehn AI von einem deutschen Pharmaunternehmen gebeten, bei der Integration der neuesten Fortschritte bei XAI-Techniken in ihr neuronales QSAR-Netzwerk Pytorch zu helfen.

Unsere Arbeit konzentrierte sich auf die Evaluierung von Erklärungswerkzeugen spezifisch für Neuronale Netze, wie Integrated Gradients (Integrierte Gradienten) über die Captum-Bibliothek, mit verallgemeinerbaren Ansätzen wie Local Interpretable Model-Agnostic Explanations (LIME) und kontrafaktischer Generierung unter Verwendung des STONED-Algorithmus in Verbindung mit Self-Referencing Embedded Strings (SELFIES) Molekularrepräsentationen. Diese Methoden wurden anhand von realen Aktivitätsklippendatensätzen verglichen und über verschiedene Modelltypen hinweg evaluiert, einschließlich tabellarischer, graphbasierter und chemischer Spracharchitekturen.

Wir implementierten eine robuste Pipeline, die es den Forschern ermöglichte, die vorhergesagten molekularen Aktivitätsbeiträge auf einzelne Atome und molekulare Fingerabdrücke abzubilden, visualisierten durch RDKit Similarity-Maps, um intuitive, chemisch sinnvolle Interpretationen zu bieten. Die Lösung wurde hinsichtlich ihrer Leistung optimiert, um eine nahtlose und effektive Integration in die bestehenden Arbeitsabläufe des Kunden zu gewährleisten, und wurde mit dessen QSAR-Produktionsplattform eingesetzt, um die Entscheidungsfindung beim rationalen Wirkstoffdesign zu unterstützen.

Wir lieferten:

- Entwicklung eines erklärbaren KI-Moduls, das in das neuronale QSAR-Netz des Kunden integriert ist

- Evaluierung von XAI-Methoden, einschließlich Captum, LIME und kontrafaktischer Daten mit SELFIES- und STONED-Algorithmen

- Unterstützung für mehrere Architekturen Neuronaler Netze mit Visualisierung durch RDKit

- Benchmarking mit Activity-Cliff-Datensätzen zur Bewertung der Relevanz und Zuverlässigkeit von Erklärungen

- Optimierung von Erklärbarkeits-Pipelines für effiziente Endnutzerinteraktion in Arbeitsabläufen

- Bereitstellung des finalen Moduls in der Produktionsumgebung des Kunden zur Unterstützung eines fundierten molekularen Designs